ChatGPTに質問したら、スラスラと自信満々の答えが返ってきた——でも、それって本当に合っていますか?

米ニューヨーク州のある弁護士は、ChatGPTに頼って訴訟資料を作りました。結果、存在しない判例を6件も引用してしまい、連邦裁判所の裁判官に見破られて制裁を受けそうになった、という事件があります。日本経済新聞の報道で世界的に話題になりました。

これが、いわゆる「AIハルシネーション」と呼ばれる現象です。AIが堂々と嘘をつく、ちょっと怖い話。でも、正体さえ知れば怖くありません。

この記事でわかることは、次の3つです。

- ハルシネーションがなぜ起きるのか、仕組みをやさしく理解できる

- ChatGPTが実際にやらかした事件を3つ知り、他人事ではないと実感できる

- すぐに使える「騙されない3つのコツ」と対策プロンプト例が手に入る

結論を先に言うと、2026年4月時点のAIでもハルシネーションは完全には防げません。だからこそ、確かめる習慣を身につけるだけで、AIの便利さを安心して活かせるようになります。

そもそもハルシネーションって何?AIが堂々と嘘をつく現象の正体

ハルシネーションとは、AIが事実ではない情報を、まるで本当のことのように自信たっぷりに答えてしまう現象です。英語の「hallucination」が語源で、日本語では「幻覚」と訳されます。

でも、人間が見る幻覚とは少しニュアンスが違います。AIが見せるこの現象は、言うなれば「本人は真剣に答えているつもりなのに、事実と違う」状態。悪意で嘘をついているわけではなく、仕組みの限界で起きてしまう現象なんです。

ざっくり言うと『AI版の作り話』

SIGNATE総研の解説によれば、ハルシネーションは「生成AIが事実とは異なる情報や、文脈に合わない内容をもっともらしく生成してしまう現象」と定義されています。ポイントは「もっともらしく」という部分。いかにも本当らしい文章で出てくるから、読んだ側は疑うことなく信じてしまいます。

たとえば、存在しない本のタイトルや架空の著者名を、さも有名な引用文献のように堂々と答える。実在しない法律の条文を引用する。会ったこともない人物の経歴を詳細に語る。どれも、AIが「知っている」わけではなく、「それっぽく作り上げている」だけなんです。

日本語の『幻覚』とは少しニュアンスが違う

「幻覚」と聞くと、なんだか病的なイメージを持つかもしれません。でもAIの場合は、その仕組みの性質上、正常に動いていても起きてしまうもの。つまり、AIが壊れているのではありません。完璧な回答をするように作られているわけでもない。ここを押さえておくと、向き合い方が変わります。

2種類のハルシネーション:内在的と外在的

専門的には、ハルシネーションは2つに分類されます。

- Intrinsic Hallucinations(内在的):AIが学習した元データと矛盾する情報を生成する。たとえば「平安時代の始まりは1600年」と答えるパターン

- Extrinsic Hallucinations(外在的):学習データに存在しない情報を、あたかも事実のように捏造する。存在しない論文・架空の人物の経歴などがこれ

どちらも見た目は「自信満々のもっともらしい文章」なので、専門用語の分類を覚える必要はありません。「AIは2種類の嘘をつく可能性がある」と頭の隅に置いておけば十分です。

なぜAIは間違えるの?3つの原因をやさしく解説

AIがハルシネーションを起こす理由は、大きく3つに整理できます。①AIは「事実を知っている」のではなく「次の言葉を予測」しているだけ、②学習したデータに偏りや古さがある、③ユーザーの質問が曖昧——この3つです。どれも仕組みの話なので、順番に見ていきましょう。

こちらはOpenAIの2025年9月論文をやさしく解説した動画です。原因をさらに深く知りたい方は参考にしてください。

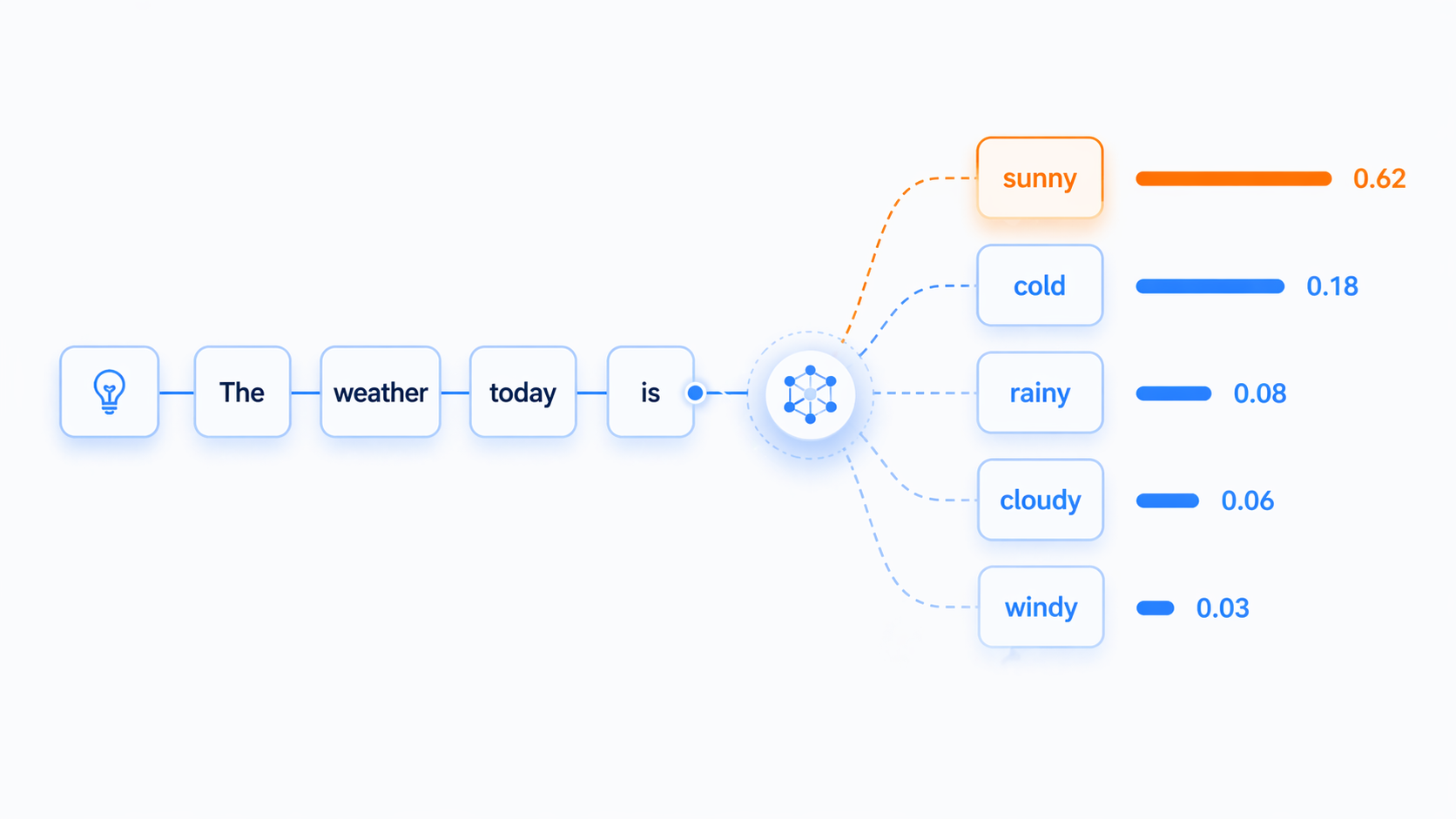

原因①:AIは『次の言葉を予測』しているだけ

一番大事なポイントがここ。ChatGPTのような大規模言語モデル(LLM)は、事実を調べて答えているのではありません。膨大な文章を学習した結果、「この単語の次にはこの言葉が続く確率が高い」というパターンを学んでいます。

言い換えると、AIは巨大なオートコンプリート機能のようなもの。スマホの文字入力で次の候補が出てくる、あれの超強化版です。「2022年のW杯優勝国は」と聞かれたら、学習データで一番確率の高い単語を繋げていく。それが正解のときも、事実と違うときもある、というわけです。

原因②:学習データが古い・偏っている

AIが学習した資料は、ある時点までのネット情報や書籍です。ChatGPTならOpenAIが公開している情報によれば、学習データには「カットオフ日」があります。そこから先に起きた出来事は、基本的に知りません。

さらに、ネット上には正確な情報もあれば、誤った情報や古い情報も混ざっています。AIは正確さを見分ける目を持たないので、学習データに入っていた誤りをそのまま覚えてしまうことも。これも誤答の大きな原因になります。

原因③:あなたの質問が曖昧だと誤解する

意外と見落とされがちなのが、この3つ目。質問があいまいだと、AIは勝手に前提を補って答えを作ります。MiraLabAIの解説によれば、曖昧なプロンプト(指示文)は誤答の発生率を大きく押し上げると整理されています。

「AIエージェントって何?」とだけ聞くのと、「2026年時点のAIエージェントの定義と代表的なツールを3つ、公式情報をもとに教えて」と聞くのでは、答えの精度が大きく変わります。詳しくはAIエージェントとは?『執事AI』の正体を初心者向けにやさしく解説でも触れていますが、AIは質問の精度にそのまま答えの精度が連動するのです。

ChatGPTはどんな嘘をつく?実際に起きた3つの事件

「ハルシネーション、仕組みはわかった。でも、本当にそんなに怖いの?」と思った皆さんへ。ここでは、実際に起きた事件レベルの事例を3つ紹介します。どれも他人事ではありません。

事件①:米国の弁護士が架空の判例6件で訴訟資料を作成

冒頭でも触れた事件です。日本経済新聞の報道によれば、米ニューヨーク南部地区連邦地裁(S.D.N.Y.)で争われた「Mata v. Avianca, Inc.」訴訟で、原告側の弁護士がChatGPTで民事訴訟の資料を作成したところ、ChatGPTが存在しない判例を6件も引用してしまいました。

判例は、事件番号・判決年・裁判官名まで細かく捏造されていました。弁護士はAIの答えをそのまま信じて提出。相手方弁護士と裁判官が判例を確認しようとしたところ、どれも見つからない。そこで発覚した、という流れです。2023年、担当のCastel判事は弁護士に5,000ドルの制裁金を命じました。

事件②:医療論文の引用47%が完全な捏造だった研究

医療分野でも衝撃的な研究結果が出ています。EARL医学ノートで紹介された研究によれば、GPT-3.5に医療コンテンツを生成させたところ、115件の引用文献のうち47%は完全な捏造、46%は存在するが情報が不正確、正確だったのはわずか7%という結果でした。

さらに細かく見ると、論文のPMID番号の誤りが93%、巻号の誤りが64%、ページ番号の誤りが64%、出版年の誤りが60%、ジャーナル名の誤りが54%、著者名の誤りが52%。ほぼ全ての要素で半分以上が間違っていた計算です。しかも生成された文章そのものは自然で、パッと見では見分けがつきません。

事件③:もっともらしい企業レポートが実在しないパターン

ビジネスの現場でも同様の誤答は頻発しています。AI Front Trendの紹介事例では、「パラマウントベッド株式会社の眠りSCAN導入実績と事例集」という具体的なタイトルの参考文献が生成されたものの、このレポート自体が実在しなかった、というケースが紹介されています。

製品名と会社名は実在するのに、レポートのタイトルだけ架空。これは見抜きにくいタイプです。業務で資料を作る方は、Copilot Coworkとは?Claude搭載『作業代行AI』の完全ガイドで紹介している業務代行AIでも、同じリスクが潜んでいると考えてください。

騙されない3つのコツとは?固有名詞・数字・出典の3点チェック

ここからが本題です。編集部が公開情報を集めて整理した結果、2026年4月時点で誰でも使える『騙されないコツ』は3つだけでした。特別な道具も専門知識も要りません。所要時間はどれも30秒〜1分です。

| コツ | やること | 所要時間 | 効果 |

|---|---|---|---|

| ①固有名詞チェック | 人名・社名・作品名を検索する | 約30秒 | 実在しない人物・架空の商品を発見 |

| ②数字の出典確認 | AIに出典URLを要求→アクセス確認 | 約1分 | 捏造統計・架空の論文を除外 |

| ③一次情報で裏取り | 公式サイト・原典で該当箇所を探す | 約1〜2分 | 内容の正確性を最終確認 |

コツ①:固有名詞は検索で『実在確認』

人名・会社名・商品名・本のタイトルが出てきたら、反射的に検索窓へ。これだけで冒頭の弁護士事件も医療論文の捏造も防げたはずです。

やり方は簡単。AIが挙げた固有名詞をコピーして、Googleで検索するだけ。該当する公式サイトや信頼できるメディアがヒットすれば実在確認OK。一件もヒットしなかったり、怪しいサイトばかり出てきたりしたら、黄色信号です。PRESIDENTの記事でも、AI研究者が「滑らかさではなく、出典・固有名詞・数値で確かめる意識」が大切だと説いています。

コツ②:数字には必ず出典を要求する

「〇〇の市場規模は1兆円」「〇〇率は87%」——AIの文章には、もっともらしい数字が散りばめられています。でも、その数字の出典は必ず聞いてください。

具体的には、AIに「その数字の出典URLを教えて」と追加で聞くだけ。信頼できる機関・大手メディアのURLが返ってきたら、実際にそのURLを開いて該当の数字があるか確認します。このステップを踏むだけで、出典が出せない数字=怪しい数字という判別ができます。AIが「URLを提示できません」と返すこともあるので、その場合は記事に使わない判断が無難です。

コツ③:一次情報(公式サイト・原典)で裏を取る

AIの回答は二次情報と割り切るのが編集部の方針です。本当に重要な話は、必ず一次情報(公式発表・原典)に当たります。

たとえばAIが「OpenAIが2025年9月に発表した論文」と言ったら、OpenAIの公式ブログまで行って該当記事を探す。ツールの機能紹介なら、そのツールの公式ドキュメントを開く。数分の手間ですが、この一手間が記事の信頼性を劇的に上げるのが、編集部が情報を集めてきた実感です。

固有名詞・数字・出典の3点確認を習慣化するだけで、AIの嘘に騙されるリスクは大幅に下がります。難しいツールもプラグインも要りません。このあとの対策プロンプト例とあわせて使えば、ChatGPTがさらに頼もしい相棒になります。

ChatGPTですぐに使える対策プロンプト例

コツだけでなく、ChatGPTへの指示文(プロンプト)を工夫するだけでも誤情報の発生率を抑えられます。ここでは、コピペで使える実用プロンプトを3つ紹介します。英語の翻訳も不要です。

こちらは2026年3月公開のプロンプト術解説動画です。動画で一緒に手を動かしたい方にもおすすめ。

プロンプト①:出典を必ず示させる指示

一番手軽で、一番効果が出るのがこれ。プロンプトの末尾に次の一文を付けるだけです。

「回答には必ず出典URLを明記してください。出典が見つからない情報は『確認できません』と答えてください。」

この指示を入れると、ChatGPTは「わからないものはわからない」と言いやすくなります。OpenAI自身の研究でも、AIを「不確実なら棄権する」方向に調整するだけで誤答率が下がると報告されています。

プロンプト②:わからないときは『わからない』と答えさせる

AIは学習データの都合上、推測で答える癖があります。これを抑えるためのプロンプトがこちら。

「根拠が不十分な場合や、学習データに該当情報がない場合は、推測せず『わかりません』と明確に答えてください。」

特に直近の情報や専門性の高い質問をするときに有効です。ChatGPTショッピングリサーチの使い方|料金と注意点を徹底解説で触れたような新機能の情報を聞くときにも、このプロンプトを添えると安心感が違います。

プロンプト③:段階的に考えさせる(Chain of Thought)

ちょっと専門的ですが、効果は抜群のテクニック。Chain of Thought(CoT、チェイン・オブ・ソート)と呼ばれ、『考え方のプロセス』を明示的に書かせる指示です。

「結論を出す前に、根拠となる事実を箇条書きで3つ挙げ、それぞれを検証してから最終的な答えを書いてください。」

いきなり結論を出させるより、考えるプロセスを経由させることで、論理の飛躍や事実誤認が減ります。ざっくり言うと「AIに宿題の途中式を書かせる」イメージです。学校の算数で暗算より筆算の方が間違えにくいのと同じ仕組み、と考えるとわかりやすいかもしれません。

ハルシネーションは完全に防げる?2026年時点のAIの実情

残念ながら、2026年4月時点のAIでも完全には防げません。これは編集部の推測ではなく、AI開発元やトップ研究者自身が認めている数字で裏付けられています。

GPT-5でも26%は残る:OpenAI自身が認めた数字

OpenAIが2025年9月に公開した論文「Why Language Models Hallucinate」によれば、GPT-5-thinking-miniは、52%の『棄権率』(わからないと答える率)を達成することで、ハルシネーション率を26%まで削減しました。

裏を返すと、「わからない」と答えなかった残りの答えのうち、約4件に1件はこの現象が起きる可能性があるということ。世界最大手のAI企業でさえ、ここまでしか改善できていないのが2026年4月時点の現実です。各社の主要モデルの動向はClaude Mythosとは?Anthropicが封印した最強AIの正体でも触れていますが、どのモデルも完璧ではありません。

HalluHardベンチマーク:最先端AIでも30%以上

さらに厳しい結果が、2026年2月に公開されたHalluHard論文(arXiv 2602.01031)で示されました。これは、法律・医療・研究・コードの4領域で、最先端AIのハルシネーション率を測定した研究です。

結果は衝撃的でした。Opus-4.5のような最上位モデルですら、Web検索機能ありで30%以上、Web検索なしで60%以上の誤答率が計測されました。しかも、引用の実在確認まで自動判定する厳しい基準です。「高性能なAIだから大丈夫」という油断は、この数字の前では通用しません。

だから『ゼロを目指す』のではなく『必ず確かめる』

ここから導かれる編集部の結論はシンプル。ハルシネーションをゼロにしようとしない。その代わり、必ず確かめる習慣を身につける。これが、2026年4月時点で最も現実的で効果の高い向き合い方です。

完全な対策を求めるほど、AIを使うのが面倒になります。ほどよく疑い、ほどよく確かめる。そのバランスこそが、AIと長く付き合うコツだと考えています。

AIとの上手な付き合い方:疑うより『確かめる』習慣を

最後に、AIをこれから便利に使いこなしたい皆さんへ。ここまでのおさらいと、明日からのスタンスについてお話しします。

AIは万能ではなく『優秀な下書き相手』

AIは、情報源ではなく「下書き相手」と割り切ると楽になります。最初の叩き台を一瞬で作ってくれる、優秀なアシスタント。でも最終判断と責任は、使う側の人間にあります。この距離感を覚えておくと、AIに過剰な期待もせず、過剰に怖がりもせず、バランスよく活用できるようになります。

30秒の確認が身を守る

「固有名詞をGoogleで検索」「数字には出典を要求」「公式サイトで裏を取る」——この3つは、慣れれば合計30秒〜1分で終わります。面倒な作業ではありません。信号を見てから道路を渡るのと同じで、習慣化してしまえば意識すらしない動作になります。

3つのコツを毎日の習慣にするだけで安心

AIを仕事や副業で使う方は、『丸投げ副業』は本当に来た?2026年版・自律型AIエージェント5選を徹底検証でも触れた通り、AIエージェントの活用機会はどんどん増えています。その分、AIの嘘を見抜くスキルが信頼できる成果物を作る鍵になっていきます。

難しい専門用語を覚える必要はありません。固有名詞・数字・出典の3点チェック——これさえ習慣にしてしまえば、AI時代を安心して楽しめる側に立てます。

よくある質問(FAQ)|ハルシネーションは完全に防げる?

Q1. AIのハルシネーションとは何ですか?

AIが事実ではない情報を、もっともらしく生成してしまう現象のことです。存在しない人物・論文・製品を自信満々に答えたり、実際の数字とまったく違う統計を提示したりします。日本語では「幻覚」と訳されますが、AIが壊れているわけではなく、仕組みの限界で起きる正常な動作です。

Q2. なぜAIは間違えるのですか?

主な理由は3つ。①AIは事実を調べているのではなく、次の言葉を確率で予測しているだけ。②学習データに古い情報や誤った情報が混ざっている。③ユーザーの質問が曖昧だとAIが勝手に前提を補うためです。仕組みそのものが原因なので、使い方を変えることが最大の対策になります。

Q3. ハルシネーションを見抜く簡単な方法はありますか?

あります。固有名詞・数字・出典の3点チェックです。人名や商品名を検索する、数字の出典URLをAIに要求する、公式サイトで該当情報を確認する——この3ステップで合計30秒〜1分。特別なツールは不要で、スマホひとつで実践できます。

Q4. ハルシネーション対策に使えるプロンプトは?

コピペで使える定番は3つ。「回答には必ず出典URLを明記してください」「根拠が不十分な場合は『わかりません』と答えてください」「結論の前に根拠を箇条書きで3つ挙げてください」。プロンプトの末尾に1文追加するだけで、誤情報の発生率を明確に下げられます。

Q5. ハルシネーションを完全に防ぐことはできますか?

2026年4月時点では不可能です。OpenAIが2025年9月に公開した論文でも、GPT-5-thinking-miniで26%のハルシネーション率が残ると報告されています。2026年2月のHalluHard研究では、Web検索機能付きの最先端AIでも30%以上発生。完全防止を目指すより、必ず確かめる習慣を作る方が現実的で効果的です。

Q6. GPT-5でもハルシネーションは起きますか?

起きます。GPT-5系モデルは旧世代より大幅に改善されましたが、ゼロにはなっていません。OpenAIの公式発表によれば、改善の鍵は「わからないときはわからないと答える」設計への変更。それでも全回答の4件に1件前後はハルシネーションの可能性が残ります。

まとめ|AIハルシネーションと上手に付き合うために

AIハルシネーションは、AIが事実と違う情報を堂々と生成してしまう現象です。仕組みの限界で起きるため、2026年4月時点のAIでも完全には防げません。でも、正体を知って3つのコツを習慣にすれば、怖がる必要はまったくありません。

本記事の要点を整理すると、次の通りです。

- ハルシネーションは仕組みの限界で起きる。AIが壊れているわけではない

- 原因は「次の言葉を予測する構造・古い学習データ・曖昧な質問」の3つ

- 対策は「固有名詞・数字・出典の3点チェック」。所要時間は合計30秒〜1分

- プロンプト末尾に「出典を示して」「わからないなら言って」を付けるだけで効果あり

- 完全防止は不可能。疑うより『確かめる』習慣を身につけるのが最適解

AIは、正しく使えば人生と仕事を大きく助けてくれる相棒です。怖がるのではなく、賢く確かめる側に回りましょう。それだけで、AIとの付き合い方が明日から変わります。

まずは次にChatGPTへ質問するとき、プロンプトの末尾に「回答には必ず出典URLを明記してください」を足してみてください。これだけで回答の質が体感で変わります。AIとの付き合い方をもっと深く知りたい方は、AIエージェントとは?『執事AI』の正体を初心者向けにやさしく解説もあわせてご覧ください。AI用語を初心者目線で整理しています。

本記事は、公式発表・公開情報・ユーザーレビューをもとに編集部が整理・分析したものです。掲載内容は執筆時点のものであり、最新情報は各公式サイトでご確認ください。

コメント